目錄

- 1.概述

- 2.部署ELK

- 2.1創建目錄和文件

- 2.2配置docker-compose并啟動

- 2.3打開kibana

- 3.收集日志

- 3.1環境準備

- 3.2使用logback記錄日志

- 3.3使用log4j2記錄日志

1.概述

1.1定義

對于大規模的日志,需要集中化的管理。而ELK提供了一整套解決方案,并且都是開源軟件,之間互相配合使用,完美銜接,高效的滿足了很多場合的應用。ELK是三種技術產品的簡稱,包括Elasticsearch、Logstash、Kibana,可在項目中作為日志框架使用。

1.2功能說明

Elasticsearch是個開源分布式搜索引擎,提供搜集、分析、存儲數據三大功能。

Logstash 主要是用來日志的搜集、分析、過濾日志的工具,支持大量的數據獲取方式。

Kibana 也是一個開源和免費的工具,Kibana可以為 Logstash 和 ElasticSearch 提供的日志分析友好的 Web 界面,可以幫助匯總、分析和搜索重要數據日志。

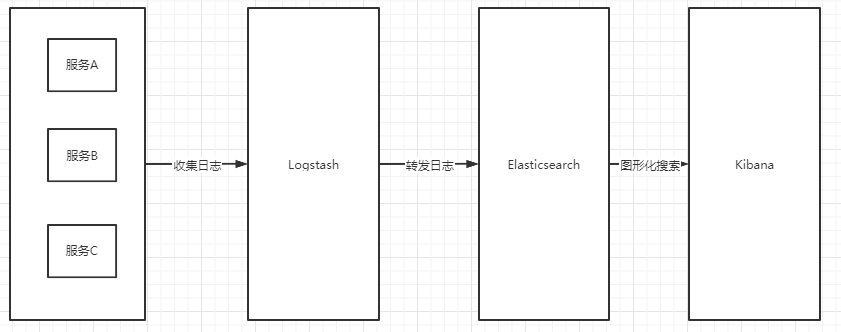

它們的作用如圖:

簡單來說,應用服務生產日志,通過Logger產生日志并輸出;Logstash通過http接收應用服務產生的日志;Elasticsearch為日志提供全文檢索功能;kibana為Elasticsearch提供圖形化界面。

2.部署ELK

本文在Linux上部署,以/opt作為根目錄進行說明。

2.1創建目錄和文件

1)創建docker-elk目錄,在此目錄創建文件和其他目錄

2)創建logstash配置文件

mkdir /opt/docker_elk/logstash

touch /opt/docker_elk/logstash/logstash.conf

3)配置logstash.conf,其內容如下

input {

tcp {

mode => "server"

host => "0.0.0.0"

port => 4560

codec => json

}

}

output {

elasticsearch {

hosts => "es:9200"

index => "logstash-%{+YYYY.MM.dd}"

}

}

在這里指定了輸入的日志的端口是4560,那么下面對外暴露的端口也必須是4560。

4)創建docker-compose.yml文件

mkdir /opt/docker_elk/docker-compose.yml

2.2配置docker-compose并啟動

打開docker-compose.yml,

cd /opt/docker_elk

vi docker_compose.yml

配置內容如下:

version: '3.7'

services:

elasticsearch:

image: elasticsearch:7.6.2

container_name: elasticsearch

privileged: true

user: root

environment:

#設置集群名稱為elasticsearch

- cluster.name=elasticsearch

#以單一節點模式啟動

- discovery.type=single-node

#設置使用jvm內存大小

- ES_JAVA_OPTS=-Xms512m -Xmx512m

volumes:

- /opt/docker_elk/elasticsearch/plugins:/usr/share/elasticsearch/plugins

- /opt/docker_elk/elasticsearch/data:/usr/share/elasticsearch/data

ports:

- 9200:9200

- 9300:9300

logstash:

image: logstash:7.6.2

container_name: logstash

ports:

- 4560:4560

privileged: true

environment:

- TZ=Asia/Shanghai

volumes:

#掛載logstash的配置文件

- /opt/docker_elk/logstash/logstash.conf:/usr/share/logstash/pipeline/logstash.conf

depends_on:

- elasticsearch

links:

#可以用es這個域名訪問elasticsearch服務

- elasticsearch:es

kibana:

image: kibana:7.6.2

container_name: kibana

ports:

- 5601:5601

privileged: true

links:

#可以用es這個域名訪問elasticsearch服務

- elasticsearch:es

depends_on:

- elasticsearch

environment:

#設置訪問elasticsearch的地址

- elasticsearch.hosts=http://es:9200

這里使用privileged設置為true是賦予這個容器root權限。然后啟動

在啟動時,如果Elasticsearch啟動報錯,說/usr/share/elasticsearch/data下的文件無權限,那么需要給宿主機授予讀寫權限

chmod 777 /opt/docker_elk/elasticsearch/data

若啟動報錯,需要先關閉并刪除容器后再重新啟動。關閉刪除命令:

2.3打開kibana

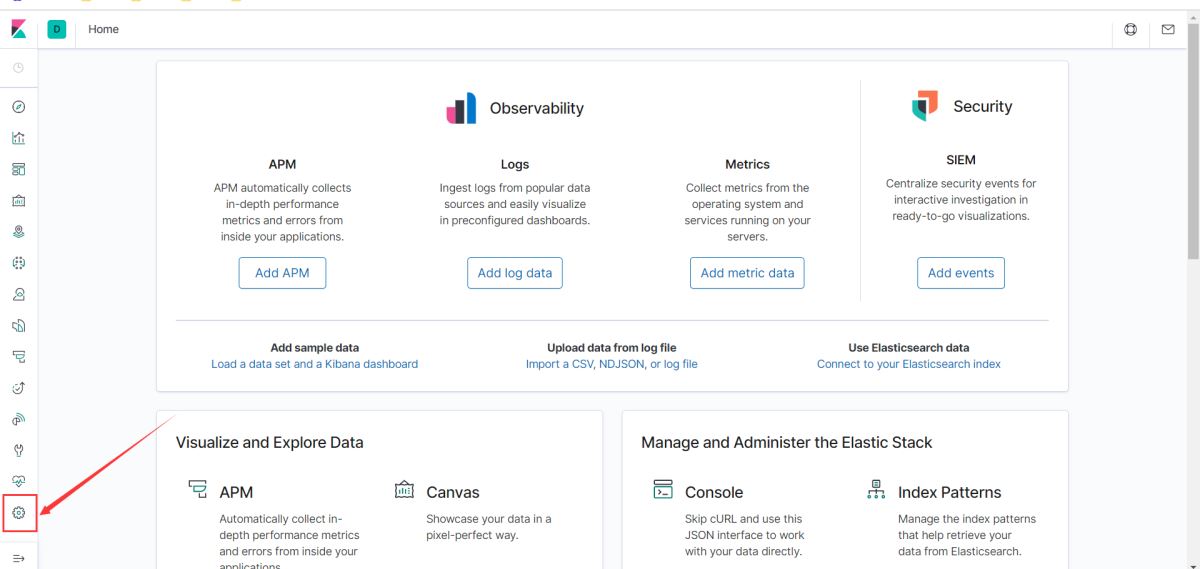

1)http://192.168.0.150:5601,訪問Kibana web界面。點擊左側設置,進入Management界面

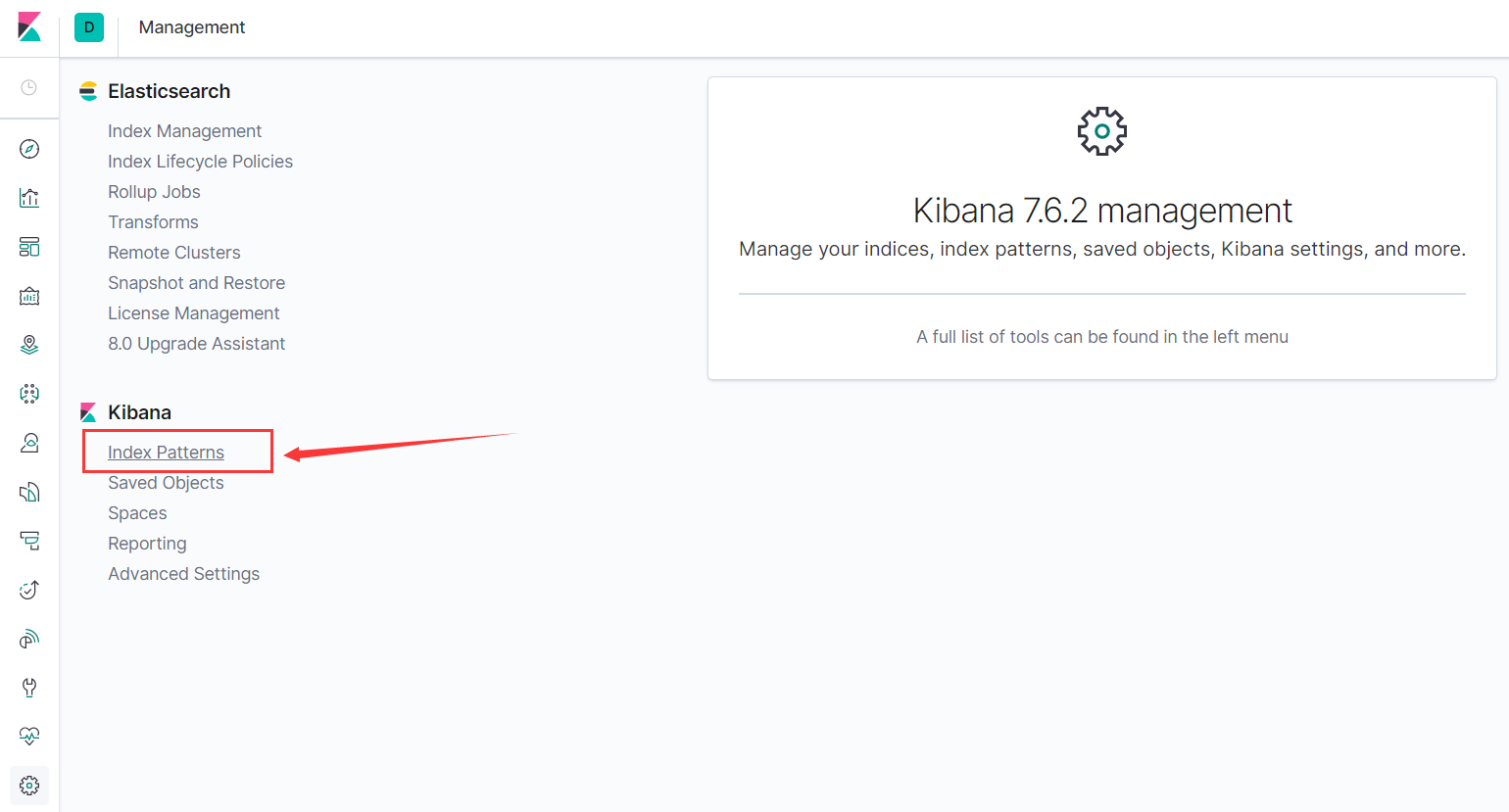

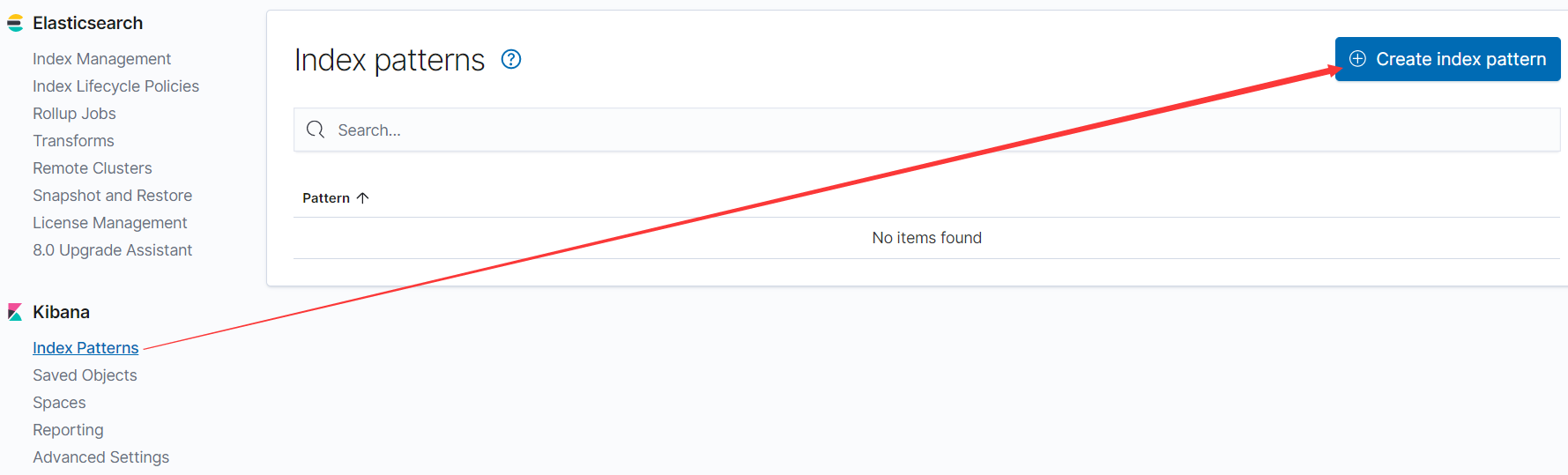

2)點擊index Patterns后,點擊創建索引

3)點擊創建索引,

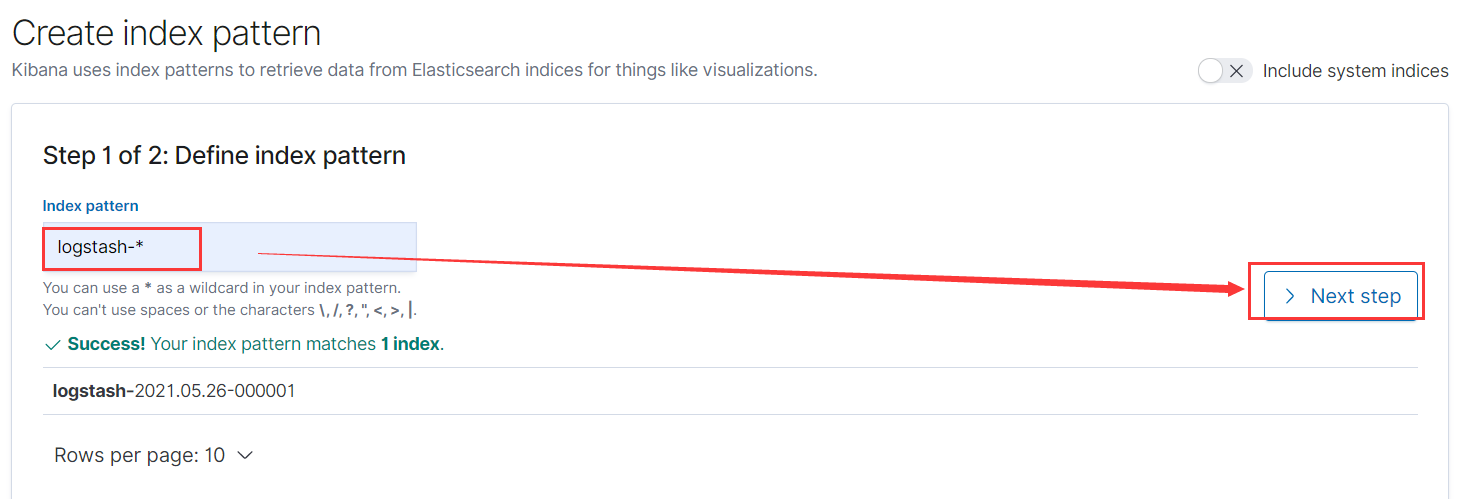

4)創建名稱為logstash-*的index,

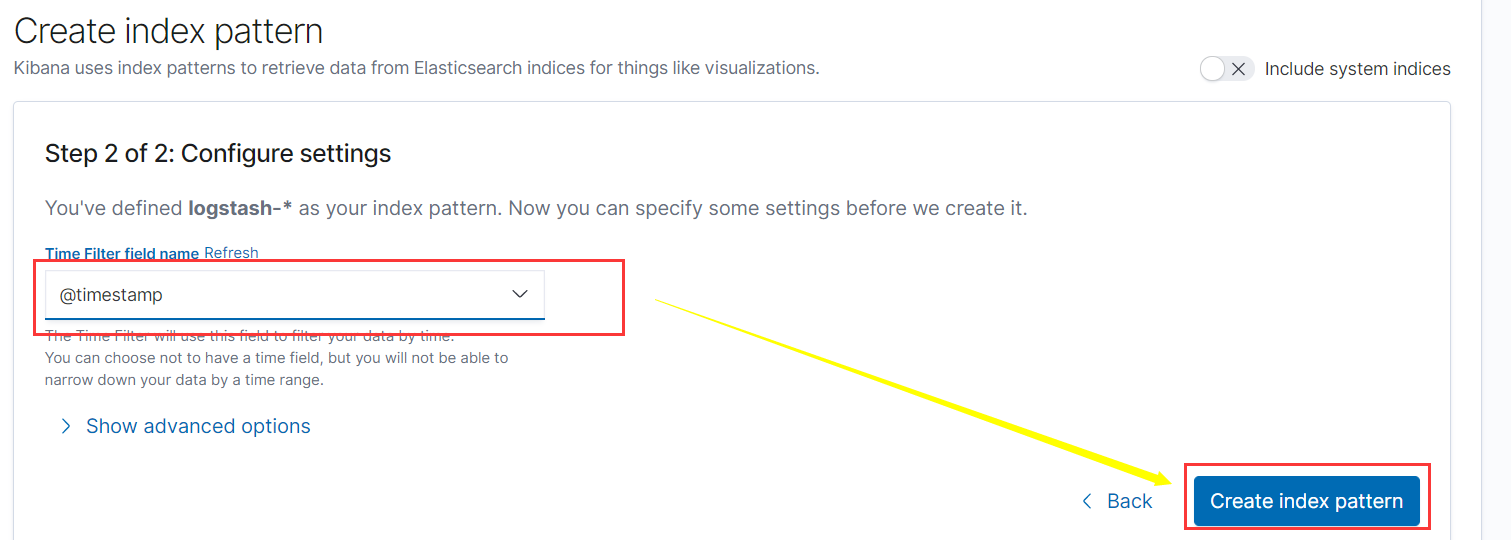

5)然后在Next Step(下一步)中選擇@timestamp的filter

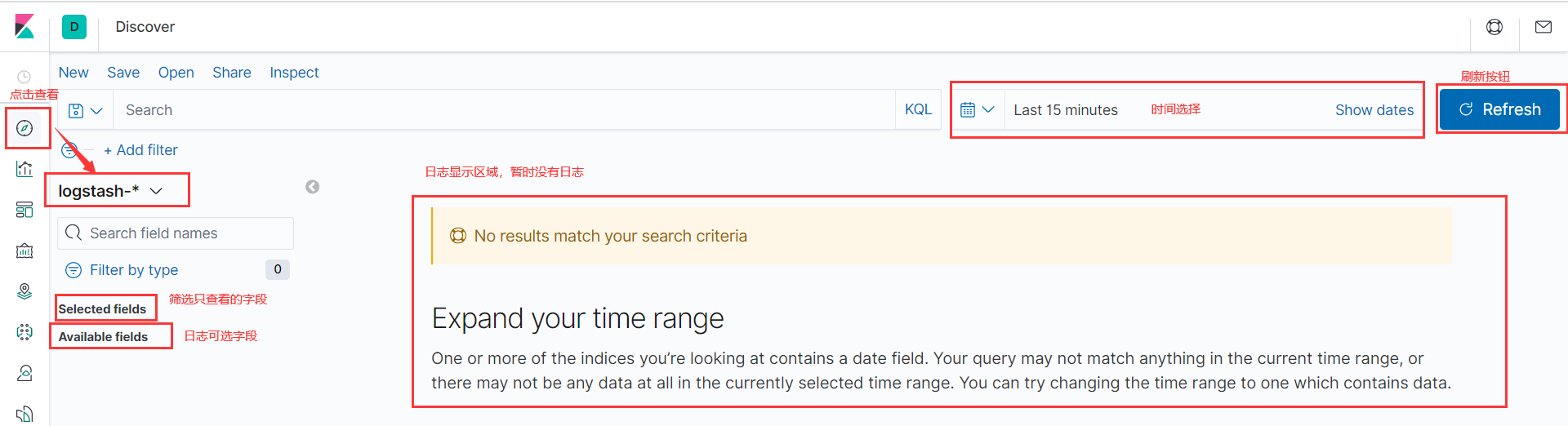

6)創建完成之后,點擊Discover,并選擇剛才創建的index

3.收集日志

本文通過SpringBoot架構把日志信息記錄到logstash。

3.1環境準備

新建一個springboot的項目,需要導入web的依賴

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

除此之外,需要導入logstash的依賴:

<!--集成logstash-->

<dependency>

<groupId>net.logstash.logback</groupId>

<artifactId>logstash-logback-encoder</artifactId>

<version>6.6</version>

</dependency>

3.2使用logback記錄日志

logback是SpringBoot自帶的日志,只要導入了web的依賴即可使用。

1)在測試包下新建一個測試類和測試方法

import org.apache.logging.log4j.LogManager;

import org.apache.logging.log4j.Logger;

import org.junit.jupiter.api.Test;

import org.springframework.boot.test.context.SpringBootTest;

@SpringBootTest

public class AppTest {

//創建日志對象

Logger logger = LogManager.getLogger(this.getClass());

@Test

public void test1() {

logger.info("logback的日志信息過來了");

logger.error("logback的錯誤信息過來了");

}

}

2)在需要目錄新建logback-spring.xml

<?xml version="1.0" encoding="UTF-8"?>

<!DOCTYPE configuration>

<configuration>

<include resource="org/springframework/boot/logging/logback/defaults.xml"/>

<include resource="org/springframework/boot/logging/logback/console-appender.xml"/>

<!--應用名稱-->

<property name="APP_NAME" value="springboot-logback-elk-demo"/>

<!--日志文件保存路徑-->

<property name="LOG_FILE_PATH" value="${LOG_FILE:-${LOG_PATH:-${LOG_TEMP:-${java.io.tmpdir:-/tmp}}}/logs}"/>

<contextName>${APP_NAME}</contextName>

<!--每天記錄日志到文件appender-->

<appender name="FILE" class="ch.qos.logback.core.rolling.RollingFileAppender">

<rollingPolicy class="ch.qos.logback.core.rolling.TimeBasedRollingPolicy">

<fileNamePattern>${LOG_FILE_PATH}/${APP_NAME}-%d{yyyy-MM-dd}.log</fileNamePattern>

<maxHistory>30</maxHistory>

</rollingPolicy>

<encoder>

<pattern>${FILE_LOG_PATTERN}</pattern>

</encoder>

</appender>

<!--輸出到logstash的appender-->

<appender name="LOGSTASH" class="net.logstash.logback.appender.LogstashTcpSocketAppender">

<!--可以訪問的logstash日志收集端口-->

<destination>192.168.86.128:4560</destination>

<encoder charset="UTF-8" class="net.logstash.logback.encoder.LogstashEncoder"/>

</appender>

<root level="INFO">

<appender-ref ref="CONSOLE"/>

<appender-ref ref="FILE"/>

<appender-ref ref="LOGSTASH"/>

</root>

</configuration>

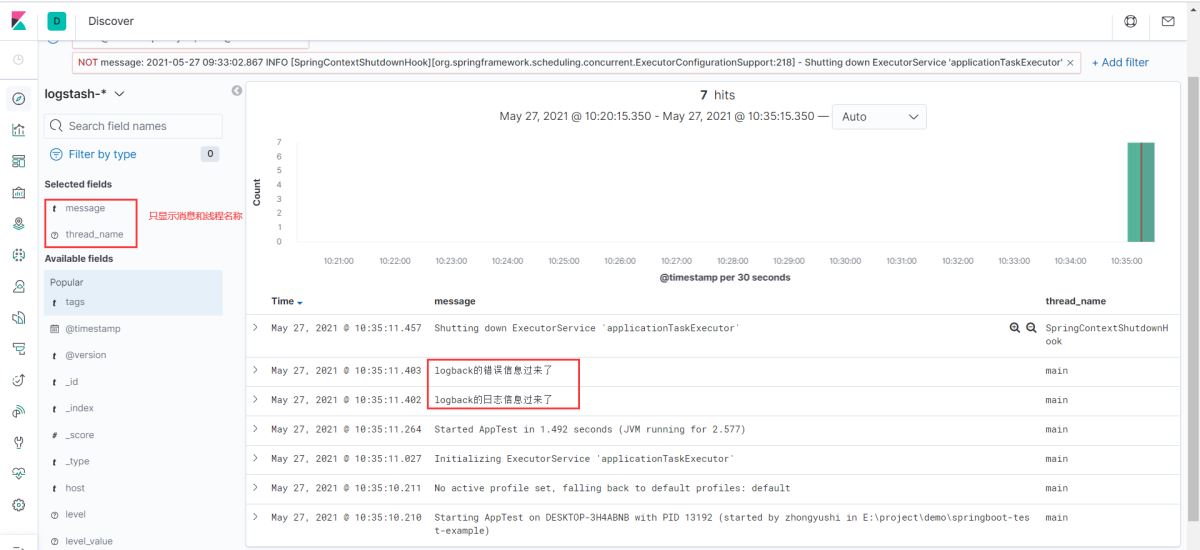

3)啟動測試方法,查看kibana的日志信息

查看信息時,建議在左側Available fields中篩選出"message"信息,"thread_name"字段可選。篩選的字段在左側也可以看到,右側看到的信息就比較清晰。

需要注意的是,在這些日志中,時間是logstash收集日志時的創建時間,并不是原始日志的記錄時間。

3.3使用log4j2記錄日志

要使用log4j2,則必須排除SpringBoot自帶的日志。

1)排除logback并導入依賴

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter</artifactId>

<exclusions>

<!-- 引入log4j日志時需去掉默認的logback -->

<exclusion>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-logging</artifactId>

</exclusion>

</exclusions>

</dependency>

<!-- 日志管理log4j2 -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-log4j2</artifactId>

<version>2.1.0.RELEASE</version>

</dependency>

2)在資源目錄下新建log4j2.xml

<?xml version="1.0" encoding="UTF-8"?>

<configuration status="info">

<Properties>

<!-- 聲明日志文件存儲的目錄 -->

<Property name="LOG_HOME">E:\logs</Property>

<Property name="LOG_PATTERN"

value="%date{yyyy-MM-dd HH:mm:ss.SSS} %-5level [%thread][%class{36}:%line] - %msg%n"></Property>

</Properties>

<Appenders>

<!--輸出控制臺的配置-->

<Console name="Console" target="SYSTEM_OUT">

<!--控制臺只輸出level及以上級別的信息(onMatch),其他的直接拒絕(onMismatch)-->

<ThresholdFilter level="info" onMatch="ACCEPT" onMismatch="DENY"/>

<!-- 輸出日志的格式-->

<PatternLayout pattern="${LOG_PATTERN}"/>

</Console>

<!--這輸出日志到文件的配置,每次大小超過size,則這size大小的日志會自動存入按年份-月份建立的文件夾下面并進行壓縮,作為存檔-->

<RollingFile name="RollingFile" fileName="${LOG_HOME}\app_${date:yyyy-MM-dd}.log"

filePattern="${LOG_HOME}\${date:yyyy-MM}\app_%d{yyyy-MM-dd}_%i.log">

<ThresholdFilter level="info" onMatch="ACCEPT" onMismatch="DENY"/>

<!-- 輸出日志的格式-->

<PatternLayout pattern="${LOG_PATTERN}"/>

<!-- 日志文件大小 -->

<SizeBasedTriggeringPolicy size="20MB"/>

<!-- 最多保留文件數 -->

<DefaultRolloverStrategy max="30"/>

</RollingFile>

<!--輸出到logstash的appender-->

<Socket name="Socket" host="192.168.86.128" port="4560" protocol="TCP">

<!--輸出到logstash的日志格式-->

<PatternLayout pattern="${LOG_PATTERN}"/>

</Socket>

</Appenders>

<!--然后定義Logger,只有定義了Logger并引入的Appender,Appender才會生效。Root中level配置了日志級別,可配置其他級別-->

<Loggers>

<Root level="info">

<AppenderRef ref="Console"/>

<AppenderRef ref="RollingFile"/>

<AppenderRef ref="Socket"/>

</Root>

</Loggers>

</configuration>

主要的上面紅色的部分,需要指定logstash服務的ip和記錄日志的端口。

3)在測試類新建測試方法

import org.apache.logging.log4j.LogManager;

import org.apache.logging.log4j.Logger;

import org.junit.jupiter.api.Test;

import org.springframework.boot.test.context.SpringBootTest;

@SpringBootTest

public class AppTest {

//創建日志對象

Logger logger = LogManager.getLogger(this.getClass());

...

@Test

public void test2() {

logger.info("我是log4j2的日志信息");

logger.error("我是log4j2的錯誤信息");

}

}

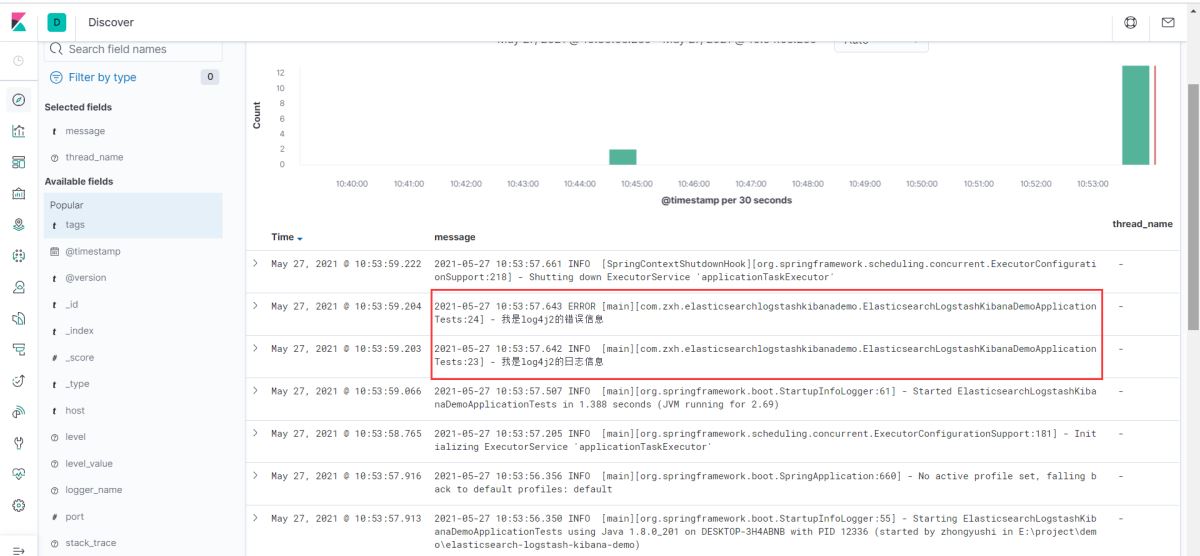

4)啟動測試方法,查看kibana的日志信息

查看信息時,建議在左側Available fields中篩選出"message"信息,"thread_name"字段可選。篩選的字段在左側也可以看到,右側看到的信息就比較清晰,包含了日志本身的時間,這是是配置日志配置的。

到此這篇關于使用Docker Compose部快速署ELK(親測有效)的文章就介紹到這了,更多相關Docker Compose部署ELK內容請搜索腳本之家以前的文章或繼續瀏覽下面的相關文章希望大家以后多多支持腳本之家!