談到大數據,相信大家對Hadoop和Apache Spark這兩個名字并不陌生。但我們往往對它們的理解只是提留在字面上,并沒有對它們進行深入的思考,下面不妨跟我一塊看下它們究竟有什么異同。

解決問題的層面不一樣

首先,Hadoop和Apache Spark兩者都是大數據框架,但是各自存在的目的不盡相同。Hadoop實質上更多是一個分布式數據基礎設施: 它將巨大的數據集分派到一個由普通計算機組成的集群中的多個節(jié)點進行存儲,意味著您不需要購買和維護昂貴的服務器硬件。

同時,Hadoop還會索引和跟蹤這些數據,讓大數據處理和分析效率達到前所未有的高度。Spark,則是那么一個專門用來對那些分布式存儲的大數據進行處理的工具,它并不會進行分布式數據的存儲。

兩者可合可分

Hadoop除了提供為大家所共識的HDFS分布式數據存儲功能之外,還提供了叫做MapReduce的數據處理功能。所以這里我們完全可以拋開Spark,使用Hadoop自身的MapReduce來完成數據的處理。

相反,Spark也不是非要依附在Hadoop身上才能生存。但如上所述,畢竟它沒有提供文件管理系統(tǒng),所以,它必須和其他的分布式文件系統(tǒng)進行集成才能運作。這里我們可以選擇Hadoop的HDFS,也可以選擇其他的基于云的數據系統(tǒng)平臺。但Spark默認來說還是被用在Hadoop上面的,畢竟,大家都認為它們的結合是最好的。

以下是從網上摘錄的對MapReduce的最簡潔明了的解析:

我們要數圖書館中的所有書。你數1號書架,我數2號書架。這就是“Map”。我們人越多,數書就更快。

現在我們到一起,把所有人的統(tǒng)計數加在一起。這就是“Reduce”。

Spark數據處理速度秒殺MapReduce

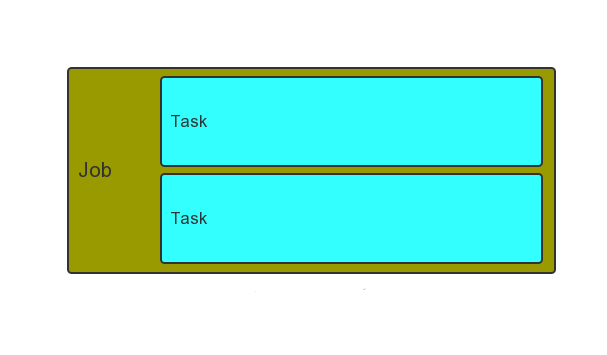

熟悉Hadoop的人應該都知道,用戶先編寫好一個程序,我們稱為Mapreduce程序,一個Mapreduce程序就是一個Job,而一個Job里面可以有一個或多個Task,Task又可以區(qū)分為Map Task和Reduce Task,如下圖所示:

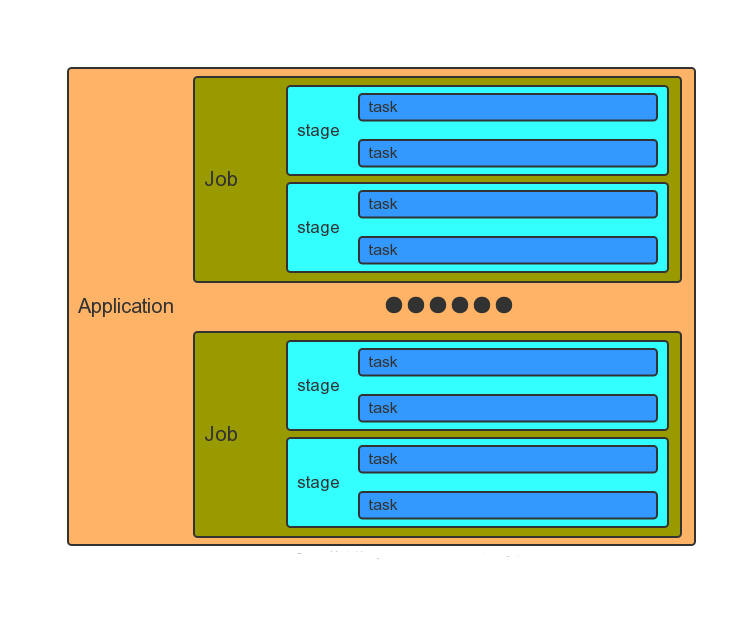

而在Spark中,也有Job概念,但是這里的Job和Mapreduce中的Job不一樣,它不是作業(yè)的最高級別的粒度,在它只上還有Application的概念。

一個Application和一個SparkContext相關聯(lián),每個Application中可以有一個或多個Job,可以并行或者串行運行Job。Spark中的一個Action可以觸發(fā)一個Job的運行。在Job里面又包含了多個Stage,Stage是以Shuffle進行劃分的。在Stage中又包含了多個Task,多個Task構成了Task Set。他們之間的關系如下圖所示:

Mapreduce中的每個Task分別在自己的進程中運行,當該Task運行完的時候,該進程也就結束了。和Mapreduce不一樣的是,Spark中多個Task可以運行在一個進程里面,而且這個進程的生命周期和Application一樣,即使沒有Job在運行。

這個模型有什么好處呢?可以加快Spark的運行速度!Tasks可以快速地啟動,并且處理內存中的數據。但是這個模型有的缺點就是粗粒度的資源管理,每個Application擁有固定數量的executor和固定數量的內存。

Spark因為其處理數據的方式不一樣,會比MapReduce快上很多。MapReduce是分步對數據進行處理的: ”從集群中讀取數據,進行一次處理,將結果寫到集群,從集群中讀取更新后的數據,進行下一次的處理,將結果寫到集群,等等…“ Booz Allen Hamilton的數據科學家Kirk Borne如此解析。

反觀Spark,它會在內存中以接近“實時”的時間完成所有的數據分析:“從集群中讀取數據,完成所有必須的分析處理,將結果寫回集群,完成,” Born說道。Spark的批處理速度比MapReduce快近10倍,內存中的數據分析速度則快近100倍。

如果需要處理的數據和結果需求大部分情況下是靜態(tài)的,且你也有耐心等待批處理的完成的話,MapReduce的處理方式也是完全可以接受的。

但如果你需要對流數據進行分析,比如那些來自于工廠的傳感器收集回來的數據,又或者說你的應用是需要多重數據處理的,那么你也許更應該使用Spark進行處理。

大部分機器學習算法都是需要多重數據處理的。此外,通常會用到Spark的應用場景有以下方面:實時的市場活動,在線產品推薦,網絡安全分析,機器日記監(jiān)控等。

災難恢復

兩者的災難恢復方式迥異,但是都很不錯。因為Hadoop將每次處理后的數據都寫入到磁盤上,所以其天生就能很有彈性的對系統(tǒng)錯誤進行處理。

Spark的數據對象存儲在分布于數據集群中的叫做彈性分布式數據集(RDD: Resilient Distributed Dataset)中。“這些數據對象既可以放在內存,也可以放在磁盤,所以RDD同樣也可以提供完成的災難恢復功能,”Borne指出。